01 Agents LLMs SmartApps 新浪潮

当你听到 「Agent」 这个词时,你可能会想到 007 或 Jason Bourne。他们可以一只手打击犯罪,另一只手喝马提尼酒,而且总是看起来很时尚。

但自从 ChatGPT 发布以来,我们看到了一种新型 Agent 的爆炸式增长。 AI Agent 是可以与环境自主或半自主交互的智能程序。

Agent 定义的争议

实际上,Agent 的定义目前仍在不断发展变化中。传统上,Agent 被定义为在数字或物理世界中(或两者兼而有之)努力实现其目标的实体。 它拥有传感器来「看见」、「听到」 和 「感知」 其环境。它还有 「actuators」 [1] (执行器),这是一个高级词汇,用来描述它与世界进行交互所使用的工具,无论是像我们使用手和手指一样的 LLM 使用 API,还是机器人夹爪捡拾垃圾,或是自动驾驶汽车通过激光雷达(LIDAR)感知环境。

但是基于超流行的 ChatGPT 和 GPT-4 等大型语言模型 (LLM) 改变了 Agent 功能的范围。 它们第一次为我们提供了能够执行各种任务的「小型大脑」,从计划、推理到回答问题和做出决策,这在早期模型中是不可能的。

然而,LLMs 存在一些众所周知的缺陷。其中之一是模型基本上会凭空编造信息,它会吸收所训练数据集中的偏见,并且由于缺乏实际依据,对错误答案也会表现出自信。这里的实际依据指的是模型无法将其生成的文本与真实世界的知识相联系。举个例子,它可能不确定地认为世界是圆的,因此有时会产生幻想,认为世界是平的。

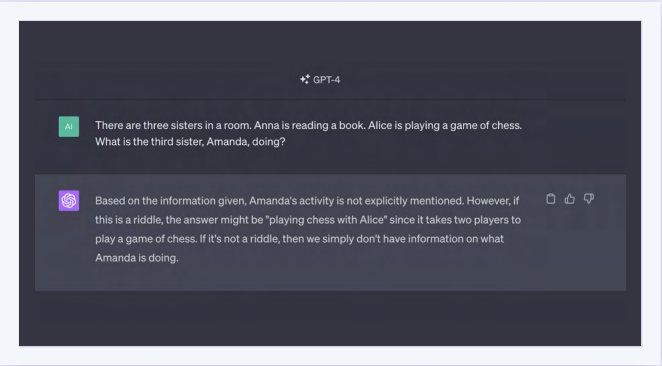

尽管存在这些缺陷,LLMs 仍然是强大的工具。我们向 GPT-4 提出了一个逻辑谜题问题,它立即给出了正确的答案,而较小的 LLMs 在处理这种情况时往往遇到困难,而且没有事先了解问题的情况下,手写代码也无法独立处理这个问题。

一份关于新兴 LLM 技术栈的最近报告将 Agent 视为纯粹的自主软件。这意味着它们可以在完全不需要人类干预的情况下进行规划和决策。

在 AIIA(人工智能基础设施联盟)中,我们对 Agent 的定义略有不同。我们认为 Agent 既可以是半自主的软件,人类在其中做出一些决策(也称为人在环中),也可以是完全自主的系统。我们还认为,人们需要明白 Agent 通常不是一个单独的、封闭的软件实体,比如 LLM 本身。我们听到 Agent 这个词,往往会想象一个完整的、自成一体的实体,这主要是因为我们将其拟人化,将其视为人类,因为人类是我们对真正智能的唯一基准。

通常,Agent 是一个相互连接的软件系统。一份来自微软研究团队的报告概述了现代 Agent 的常见和实用方法,其中 LLM 使用其他模型(如 Stable Diffusion XL) 或编码模型(如 WizardCoder)来执行更高级的任务。它也可以像我们使用手和腿一样使用 API。它将这些工具作为扩展来控制外部软件或与世界进行交互。为了实现这一点,LLM 可以通过自己的 API 知识进行训练,作为其数据集的一部分或经过微调的数据集,或者它可以使用另一个明确针对 API 进行训练的外部模型。例如 Gorilla。

在 AIIA 中,我们将 Agent 视为任何与物理或数字世界进行交互并能够做出过去通常属于人类认知领域的决策的软件系统。

- 我们将半自主 Agent 称为

Centaur[2] 。这些是带有人类在环中的智能软件。 - Agent 可以是完全自主或几乎完全自主的软件实体,可以在没有人类干预的情况下进行规划和做出复杂决策。

我们可以将 Centaur [2] 视为 「固定轨道上的 Agent」,是完全自主 Agent 的前身。只要任务明确并有明确的限制条件,只要有人对其工作进行检查或在各个步骤中进行干预,Centaur [2] 就可以完成复杂任务。

Agent 是完全自主的,可以在没有人类干预的情况下完成工作。

在 Agent 系统中,自动化水平的一个很好的例子来自于自动驾驶汽车领域,这在李开复和陈楸帆的书中《AI 2041》有很好的阐述。自动驾驶系统被美国汽车工程师协会(SAE)分为0级(L0)到5级(L5):

- L0(零自动化)意味着人类进行所有驾驶操作,但 AI 会监视道路并警告驾驶员潜在问题,例如跟车过近。

- L1(手握方向盘)意味着只要驾驶员密切关注,AI 可以执行特定的任务,如转向。

- L2(双手离开方向盘)意味着 AI 可以执行多个任务,如制动、转向、加速和转弯,但系统仍然期望人类进行监督,并在需要时接管驾驶。

- L3(视线离开道路)意味着 AI 可以完全接管驾驶的所有方面,但仍需要人类随时准备接管,以防出现问题或 AI 犯错。

- L4(心思离开)是指 AI 可以完全接管整个行程的驾驶,但前提是在 AI 非常熟悉的明确定义的道路和良好开发的环境下,例如已经进行了高清地图和调查的高速公路和城市街道。

- L5(方向盘可选)意味着在任何道路或环境下都不需要人类干预,也不需要人类接管的方式,因此方向盘是可选的。

我们可以将 L0 到 L3 看作是新车上的额外选项,就像空调、皮座椅或定速巡航一样。 它们仍然需要人类驾驶。这些就像现在大多数 Agent 一样,需要人类在其中发挥作用。例如,大多数人不愿意让 Agent 写一封电子邮件给他们的老板或他们的母亲,而在发送之前没有阅读它。 然而,当我们达到 L4 时,车辆背后的智能开始感觉像是拥有自己思维的真正智能,并且将对社会产生巨大影响。L4 级别的车辆或公交车可以自信地行驶特定的公共路线,而 L5 级别的车辆或卡车可以在一天的任何时间进行交付,或者像 Uber 一样成为机器人出租车,可以带您去任何地方。

自 GPT-3 和 GPT-4 发布以来,我们已经看到了一些尝试构建完全自主的 L5 级别的数字世界 Agent 的努力,如 BabyAGI 和 AutoGPT 。程序员们希望利用 LLM 来执行诸如规划复杂的软件需求、根据用户请求预订机票、为生日派对准备礼物或计划公司招聘等行动。

不幸的是,它们目前大多还无法进行长期规划、推理和执行复杂任务。我们想象中的 AI 系统可以为新产品制定全面的营销计划,编写和创建网站,制定所有外联信息,获取要联系的人员列表,然后发送电子邮件以获取新客户。我们尚未达到这一水平,但这并不意味着我们在某个时候不会实现。随着越来越多的传统程序员涉足机器学习,并应用数据科学家和数据工程师所不会考虑的想法(因为这些超出了他们的领域知识),我们不断看到这些系统的持续改进。完全自主的 Agent 可能在不久的将来或未来十年成为我们生活中无处不在的一部分。

许多这些完全自主的项目引起了巨大的公众兴趣。AutoGPT 在 GitHub 上的 star 积累速度比几乎任何其他项目都快,但我们不能再将 GitHub上 的星标数作为软件能力的真实衡量标准。 对人工智能的巨大公众兴趣往往是受到科幻小说和好莱坞大片的推动,而不是技术的实际现状。这种外部兴趣有时会使全新的项目一度风靡 GitHub,但很快就会看到实际的开发者兴趣迅速消退。 当认知失调出现时,软件并没有达到人们对超智能软件化身的期望,就像电影 Her 中的人工智能一样,这种情况就会发生。

尽管如此,一些这些项目仍然吸引着热情的追随者,他们继续使用人工智能软件(如 BabyAGI)为这些项目增加新的功能。不仅如此,Agent 的推理和规划也在不断发展,软件和研究项目结合了新的技术来帮助 LLM 更好地思考,例如 chain-of-thought(CoT)提示工程,或者通过像斯坦福团队的 Generative Simulacra 项目给它们提供可回溯的历史,等等诸如此类的项目…